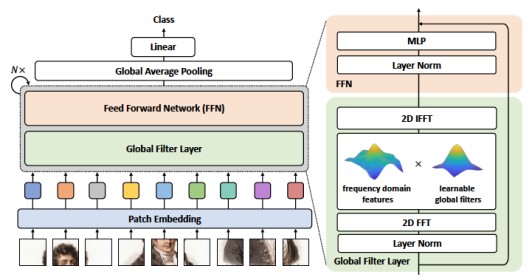

清华大学副教授、智源青年科学家鲁继文团队提出了基于离散傅里叶变换和全局滤波机制的全新空间信息混合方法,解决了视觉任务高空间分辨率下自注意模型复杂度二次增长的挑战,为未来高效视觉基础模型提供了新的思路。GFNet兼具MLP模型的高效性和自注意力模型的高性能,在不使用传统局部卷积和自注意的情况下在ImageNet图片分类任务和下游语义分割任务上均能在相似复杂度下取得和PVT和Swin Transformer等自注意模型相媲美的性能,相关成果发表在机器学习领域顶级会议NeurIPS 2021上。

Yongming Rao, Wenliang Zhao, Zheng Zhu, Jiwen Lu*, Jie Zhou, Global Filter Networks for Image Classification, NeurIPS 2021.